La Evolución de las Operaciones: Desde DevOps hacia MLOps y LLMOps

En el mundo tecnológico actual, la velocidad de innovación es impresionante, y con ella ha surgido una evolución fascinante en las metodologías operativas. En OpsAnalytics, hemos observado de primera mano cómo las organizaciones pasan de las prácticas DevOps tradicionales hacia enfoques más especializados como MLOps y LLMOps, especialmente a medida que adoptan inteligencia artificial y aprendizaje automático.

Esta transición no es solo una cuestión de terminología, sino una respuesta fundamental a nuevos desafíos técnicos. Mientras DevOps se centra en la entrega rápida y confiable de software convencional, MLOps y LLMOps abordan las complejidades únicas de los sistemas de inteligencia artificial en producción.

Entendiendo los Fundamentos: DevOps como Base

El enfoque DevOps, que muchos de nuestros clientes han adoptado con éxito, se centra en acortar los ciclos de desarrollo, mantener la calidad mediante integración y entrega continua (CI/CD), y operar servicios de manera confiable. En OpsAnalytics hemos implementado transformaciones DevOps en sectores como seguros, retail y manufactura, observando cómo algunas organizaciones logran reducir el tiempo de inactividad hasta en un 99.9%.

La fortaleza de DevOps radica en su capacidad para automatizar procesos, mejorar la colaboración entre equipos y crear una cultura de mejora continua. Sin embargo, cuando los equipos comienzan a implementar sistemas de aprendizaje automático, encuentran limitaciones significativas en estas prácticas tradicionales.

La Revolución de MLOps: Más Allá del Código

MLOps representa una extensión especializada de DevOps que aborda las particularidades de los sistemas de aprendizaje automático. Un punto crucial que destaca el material estudiado es que «el modelo de ML en sí mismo es solo una pequeña parte de un sistema de ML en producción». La infraestructura circundante para datos, configuración, automatización, implementación y monitoreo es mucho más grande y compleja.

A diferencia del desarrollo de software tradicional, que es un proceso determinista, el desarrollo de ML es altamente experimental y basado en datos. Los equipos prueban múltiples algoritmos, características e hiperparámetros para encontrar lo que funciona mejor. Esto añade el desafío de rastrear experimentos, manejar resultados estocásticos y garantizar la reproducibilidad.

En MLOps, la versión de datos y modelos (no solo del código) se vuelve crítica, algo que DevOps tradicional no cubre por defecto. Además, los sistemas de ML requieren pruebas adicionales: no solo necesitamos pruebas unitarias para nuestros pasos de preprocesamiento de datos, sino también validar la calidad de los datos y evaluar el rendimiento del modelo entrenado.

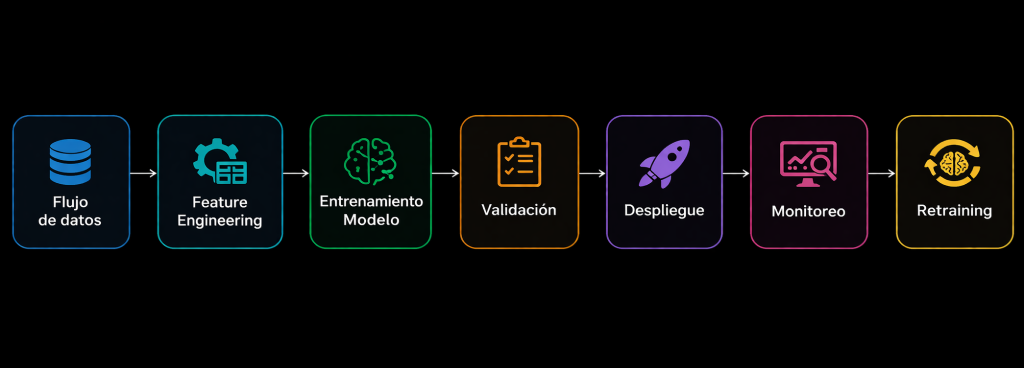

Ciclo de Vida Extendido del ML

MLOps introduce conceptos como entrenamiento continuo (CT) además de CI/CD. Esto significa que el sistema puede activar el reentrenamiento cuando llegan nuevos datos o cuando el rendimiento se degrada, cerrando el ciclo entre los datos y la implementación. Esta capacidad es fundamental porque, una vez desplegados, los modelos ML enfrentan condiciones del mundo real que cambian: los usuarios pueden comportarse de manera diferente con el tiempo, los datos pueden desviarse y el rendimiento del modelo puede deteriorarse.

Sin MLOps adecuado, un modelo preciso puede volverse rápidamente poco confiable o incluso dañino cuando sirve a los clientes. La falta de operaciones adecuadas puede llevar a que modelos obsoletos o incorrectos permanezcan en producción, causando predicciones erróneas que perjudican al negocio.

La Especialización de LLMOps: Optimización de Agentes y Prompt Engineering

Con el auge de los modelos de lenguaje grandes (LLMs), ha emergido una especialización aún más específica: LLMOps. Esta disciplina se enfoca en las operaciones de sistemas basados en LLM, donde herramientas como Opik Agent Optimizer demuestran la evolución de estas prácticas.

LLMOps aborda desafíos únicos como:

- Optimización automática de prompts mediante algoritmos especializados

- Gestión de herramientas y firmas MCP (Model Context Protocol)

- Sistemas multi-agente con observabilidad profunda

- Parámetros específicos de LLM como temperatura, top_p, etc.

Las herramientas modernas de LLMOps ofrecen capacidades como la optimización mediante MetaPrompt, HRPO (Hierarchical Reflective Prompt Optimizer), algoritmos evolutivos y GEPA, cada uno con fortalezas específicas para diferentes tareas de optimización.

Tabla Comparativa: DevOps vs. MLOps vs. LLMOps

| Aspecto | DevOps | MLOps | LLMOps |

|---|---|---|---|

| Enfoque principal | Entrega rápida y confiable de software | Ciclo de vida completo de modelos ML | Optimización y operación de sistemas LLM |

| Naturaleza del desarrollo | Determinista | Experimental y basado en datos | Prompts, parámetros, herramientas, agentes |

| Elementos versionados | Código, configuración | Código, datos, modelos, experimentos | Prompts, parámetros, herramientas, agentes |

| Pruebas adicionales | Unitarias, integración, funcionales | Calidad de datos, rendimiento del modelo, sesgo | Efectividad de prompts, comportamiento del agente |

| Automatización clave | CI/CD (Integración/Entrega Continua) | CI/CD/CT (Entrenamiento Continuo) | Optimización continua de prompts y agentes |

| Métrica de éxito | Tiempo de entrega, estabilidad | Rendimiento del modelo, deriva de datos | Calidad de respuestas, costo por token |

| Infraestructura crítica | Servidores, contenedores, orquestación | Pipelines de datos, almacenamiento de modelos | APIs de LLM, sistemas de caching de respuestas |

Implementación Estratégica para Empresas

En OpsAnalytics, recomendamos un enfoque gradual para la adopción de estas metodologías:

- Consolidar primero las bases DevOps antes de avanzar a MLOps

- Evaluar la madurez actual en gestión de datos y procesos experimentales

- Comenzar con casos de uso específicos antes de escalar horizontalmente

- Invertir en observabilidad y monitoreo desde el inicio

- Fomentar la colaboración entre equipos de ciencia de datos, ingeniería y operaciones

Para organizaciones que ya tienen implementaciones ML en producción, el siguiente paso natural es establecer mecanismos de retraining automático y sistemas de monitoreo de la calidad de datos. Para aquellas experimentando con LLMs, la prioridad debe ser establecer procesos para la optimización sistemática de prompts y evaluación del comportamiento de agentes.

Conclusión: Un Continuum de Madurez Operacional

La evolución de DevOps a MLOps y LLMOps representa un continuum de especialización operacional que responde a las complejidades técnicas de sistemas cada vez más sofisticados. Lo que comenzó como una metodología para acelerar la entrega de software tradicional ahora se especializa para abordar los desafíos únicos del aprendizaje automático y los modelos de lenguaje grandes.

En OpsAnalytics, creemos que comprender estas diferencias y similitudes es crucial para las organizaciones que buscan escalar sus capacidades de inteligencia artificial sin perder velocidad ni control. La clave está en reconocer que cada transición requiere no solo nuevas herramientas, sino también ajustes en procesos, habilidades organizacionales y cultura de colaboración.

¿Tu organización está considerando esta evolución operacional? En próximos artículos profundizaremos en estrategias específicas de implementación para cada uno de estos dominios operativos.

Ejemplo Práctico: Sistema de Recomendación de Productos

Vamos a mostrarte cómo evoluciona un sistema de recomendación de productos para un e-commerce al implementar cada enfoque operacional. Este ejemplo te permitirá ver claramente las diferencias prácticas.

Fase 1: DevOps (Sistema Tradicional)

Contexto: Tu empresa necesita un sistema básico de recomendación basado en reglas de negocio predefinidas.

Código python

# Sistema DevOps tradicional

class BasicRecommendationSystem:

def __init__(self):

self.rules = {

'category_match': True,

'price_range': (10, 100),

'in_stock': True

}

def recommend(self, user_history):

# Lógica determinista basada en reglas

recommendations = self.apply_business_rules(user_history)

return recommendations[:5]Flujo DevOps típico:

- Desarrollo: Código con lógica determinista

- Pruebas: Unitarias e integración (¿devuelve 5 productos?)

- CI/CD: Pipeline automatizado despliega código

- Monitoreo: Latencia, disponibilidad, logs de errores

- Actualizaciones: Nuevo release cada 2 semanas con mejoras en las reglas

Problema encontrado: Las recomendaciones son genéricas, no personalizadas. La conversión es baja porque todos los usuarios ven casi lo mismo.

Fase 2: MLOps (Sistema con Machine Learning)

Contexto: Decides implementar un modelo de ML que aprende de los comportamientos de los usuarios.

Código python

# Sistema MLOps - Mucho más complejo

class MLRecommendationSystem:

def __init__(self):

self.model = None

self.feature_store = FeatureStore()

self.data_pipeline = DataPipeline()

self.model_registry = ModelRegistry()

def train_pipeline(self):

# Pipeline de entrenamiento automatizado

data = self.data_pipeline.collect(user_interactions, product_catalog)

features = self.feature_store.compute_features(data)

self.model = self.train_model(features)

self.evaluate_model() # Validación estadística

self.model_registry.register(self.model, version='v2.1')

def recommend(self, user_id):

# Predicción en tiempo real

user_features = self.feature_store.get_user_features(user_id)

predictions = self.model.predict(user_features)

return self.format_recommendations(predictions)Flujo MLOps completo:

Componentes clave añadidos:

- Feature Store: Almacena características de usuarios/productos

- Data Pipeline: Procesa datos cada 24h para reentrenamiento

- Model Registry: Control de versiones de modelos

- Monitoring: Seguimiento de data drift y concept drift

- CI/CD/CT: Entrenamiento continuo cuando el rendimiento baja del 85%

Problema encontrado: El modelo funciona bien al inicio, pero luego:

- Los usuarios preguntan cosas específicas («para regalo de niño de 5 años»)

- Las búsquedas por lenguaje natural no se interpretan bien

- Las recomendaciones no consideran contexto conversacional

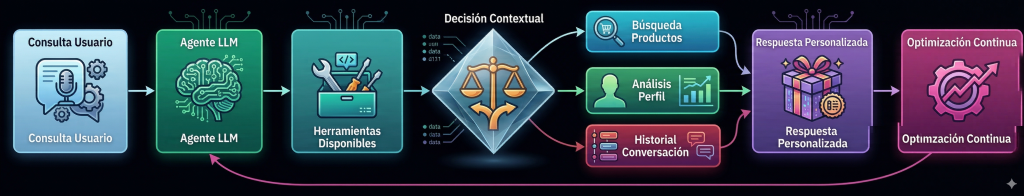

Fase 3: LLMOps (Sistema con Modelos de Lenguaje)

Contexto: Implementas un agente conversacional que entiende lenguaje natural y genera recomendaciones contextuales.

Código python

# Sistema LLMOps con agente inteligente

class LLMRecommendationAgent:

def __init__(self):

self.llm_client = LLMClient(model="gpt-4")

self.tools = [

ProductSearchTool(),

UserProfileTool(),

ConversationHistoryTool(),

ReviewAnalyzerTool()

]

self.prompt_optimizer = OpikAgentOptimizer()

self.evaluator = RecommendationEvaluator()

def optimize_prompt(self):

# Optimización automática del prompt del sistema

optimized_prompt = self.prompt_optimizer.optimize(

initial_prompt="Eres un asistente de recomendaciones...",

dataset=conversation_examples,

metrics=[relevance_score, conversion_likelihood]

)

return optimized_prompt

def recommend(self, user_query, conversation_history):

# Agente con razonamiento y herramientas

context = self.build_context(user_query, conversation_history)

response = self.llm_client.generate(

system_prompt=self.optimized_prompt, # Prompt optimizado

user_message=user_query,

tools=self.tools,

temperature=0.3, # Parámetro optimizado

max_tokens=500

)

# Log para observabilidad

self.log_trace({

'query': user_query,

'tools_used': response.tools_called,

'token_usage': response.usage,

'confidence': response.confidence_score

})

return response.recommendations

Flujo LLMOps característico:

Componentes únicos de LLMOps:

- Prompt Optimization: Mejora automática de instrucciones al modelo

- Tool Calling: El LLM decide qué herramientas usar (buscar productos, consultar perfil)

- Parameter Tuning: Ajuste de temperatura, top_p para balancear creatividad/consistencia

- Trace Logging: Registro detallado de razonamiento del agente

- Multi-turn Context: Mantiene contexto conversacional

- Cost Optimization: Balance entre calidad de respuesta y tokens usados

Comparación Práctica de los Tres Enfoques

| Escenario | DevOps | MLOps | LLMOps |

|---|---|---|---|

| Usuario pregunta: «Necesito un regalo para mi sobrina de 7 años que le gusta el arte» | Recomienda productos en categoría «juguetes + arte» (reglas predefinidas) | Recomienda productos comprados por usuarios similares (cluster de usuarios) | Conversación: «¿Prefieres materiales de dibujo, kits de manualidades o juegos creativos? Mi sobrina de 6 años adora los kits de pintura por números» |

| Actualización del sistema | Deploy manual cada 2 semanas con nuevas reglas | Pipeline de reentrenamiento automático cada 24h | Optimización de prompts en tiempo real basada en conversaciones exitosas |

| Problema técnico típico | Servidor caído, error 500 | Data drift: nuevos productos no tienen embeddings | Prompt injection, respuestas inconsistentes |

| Métricas clave | Disponibilidad 99.9%, tiempo respuesta <200ms | Precisión 85%, cobertura 70%, ROC-AUC 0.89 | Satisfacción usuario 4.5/5, tasa conversión 12%, costo por conversación $0.03 |

| Escalabilidad | Más servidores, balanceo de carga | Más clusters de entrenamiento, feature stores distribuidos | Optimización de tokens, caching de respuestas, modelos más eficientes |

| Equipo necesario | DevOps Engineer, Backend Developer | Data Engineer, ML Engineer, Data Scientist | Prompt Engineer, LLM Ops Engineer, Conversation Designer |

Lecciones Aprendidas del Ejemplo

- Complejidad creciente pero valor añadido: Cada transición añade complejidad pero también capacidades más sofisticadas.

- Evolución natural: Muchas empresas empiezan con DevOps, luego implementan MLOps para casos específicos, y finalmente exploran LLMOps para interfaces conversacionales.

- Costos diferentes:

- DevOps: costo de infraestructura

- MLOps: costo de datos + entrenamiento

- LLMOps: costo de tokens LLM + optimización

- Tiempo de implementación:

- DevOps: 2-4 semanas

- MLOps: 2-3 meses (con pipelines robustos)

- LLMOps: 1-2 meses pero con iteración continua

Recomendación para Implementación Gradual

En OpsAnalytics sugerimos este camino:

- Semana 1-4: Implementa sistema DevOps básico con reglas simples

- Mes 2-3: Añade un modelo ML simple (MLOps light) para personalización básica

- Mes 4-6: Implementa LLM para búsqueda conversacional mientras refinas el pipeline MLOps

- Mes 6+: Sistema híbrido donde cada enfoque maneja lo que mejor hace

¿Cuál es el mayor cambio mental? Pasar de pensar en «código que ejecuta» (DevOps) a «modelos que aprenden» (MLOps) y finalmente a «agentes que razonan» (LLMOps).

¿Te gustaría que profundice en algún aspecto específico de esta implementación práctica?

pon un ejemplo práctico (Empresa de seguros) para las 3 opraciones: DevOps, MLOps y LLMOps

Caso Práctico: Sistema de Cálculo de Primas en una Aseguradora

Voy a mostrarte cómo una empresa de seguros evoluciona su sistema de cálculo de primas y evaluación de riesgos implementando DevOps, MLOps y LLMOps. Este ejemplo realista te mostrará las diferencias operacionales concretas.

Contexto de la Empresa de Seguros

Seguros Futuro S.A. tiene:

- 500,000 clientes de seguros de auto

- 50 agentes en campo

- Portal web y app móvil

- Necesita calcular primas y evaluar siniestros

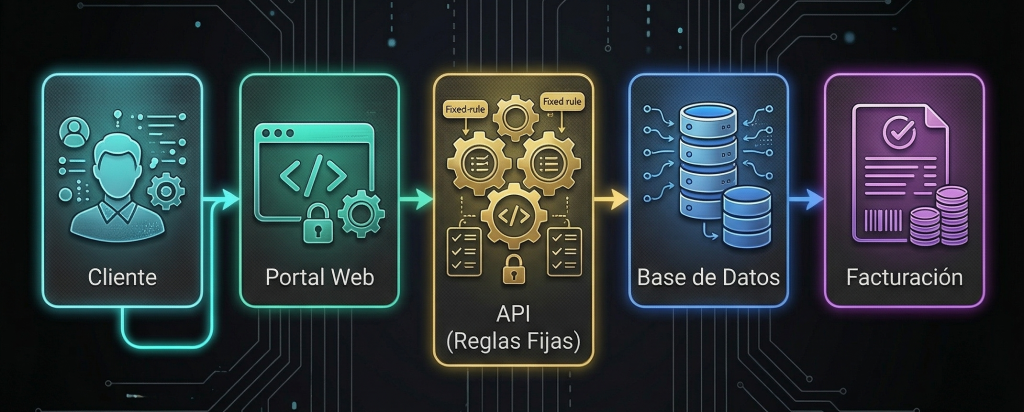

Fase 1: DevOps (Sistema Tradicional de Cálculo de Primas)

Problema inicial: Cálculo manual de primas con tablas estáticas de Excel, procesos lentos propensos a errores.

Código python

# Sistema DevOps - Lógica determinista basada en reglas

class TraditionalInsuranceCalculator:

def __init__(self):

self.base_rates = {

'auto': {'base': 500, 'per_age': 10},

'home': {'base': 300, 'per_value': 0.001},

'health': {'base': 400, 'per_age': 15}

}

self.discount_rules = {

'good_driver': 0.15,

'multiple_policies': 0.10,

'loyalty_5_years': 0.05

}

def calculate_premium(self, customer_data):

# Cálculo determinista basado en reglas fijas

base = self.base_rates[customer_data['policy_type']]['base']

age_factor = customer_data['age'] * self.base_rates[customer_data['policy_type']].get('per_age', 0)

premium = base + age_factor

# Aplicar descuentos

for discount_type in customer_data.get('discounts', []):

premium *= (1 - self.discount_rules.get(discount_type, 0))

return round(premium, 2)

Flujo Operacional DevOps:

Pipeline CI/CD DevOps:

yaml

# .github/workflows/deploy.yml

name: Deploy Insurance Calculator

on:

push:

branches: [main]

jobs:

test-and-deploy:

runs-on: ubuntu-latest

steps:

- name: Run Unit Tests

run: python -m pytest test_calculator.py

- name: Deploy to Staging

run: kubectl apply -f k8s/staging/

- name: Integration Tests

run: ./run_integration_tests.sh

- name: Deploy to Production

if: success()

run: kubectl apply -f k8s/production/

Problemas encontrados:

- Primas no competitivas: Los competidores con ML tienen precios más precisos

- Fraudes no detectados: Patrones de siniestros sospechosos pasan desapercibidos

- Tiempo de respuesta: 48 horas para evaluar siniestros complejos

- Actualizaciones lentas: Cambiar tablas requiere deploy manual

Fase 2: MLOps (Sistema Predictivo de Riesgo)

Transformación: Implementan modelos ML para:

- Predecir probabilidad de siniestro

- Detectar fraudes potenciales

- Personalizar primas individualmente

Código python

# Sistema MLOps - Pipeline completo de ML

class MLRiskAssessmentSystem:

def __init__(self):

self.feature_pipeline = FeaturePipeline()

self.model_trainer = ModelTrainer()

self.model_serving = ModelServing()

self.monitoring = ModelMonitoring()

def retraining_pipeline(self):

"""Pipeline automatizado de reentrenamiento"""

# 1. Recolectar nuevos datos

new_claims = self.collect_recent_claims(last_90_days=True)

new_customers = self.collect_new_customer_data()

# 2. Ingeniería de características

features = self.feature_pipeline.transform({

'demographics': new_customers,

'claims_history': new_claims,

'external_data': weather_data, traffic_data

})

# 3. Entrenar modelos

risk_model = self.model_trainer.train(

features=features,

target='claim_probability',

algorithm='xgboost',

test_size=0.2

)

fraud_model = self.model_trainer.train(

features=features,

target='is_fraudulent',

algorithm='isolation_forest'

)

# 4. Validación rigurosa

if self.validate_models(risk_model, fraud_model):

# 5. Despliegue canario

self.model_serving.deploy_canary(

new_models={'risk': risk_model, 'fraud': fraud_model},

traffic_percentage=10

)

# 6. Monitoreo continuo

self.monitoring.setup_alerts(

metrics=['accuracy_drop', 'data_drift', 'concept_drift'],

thresholds={'accuracy_drop': 0.05}

)

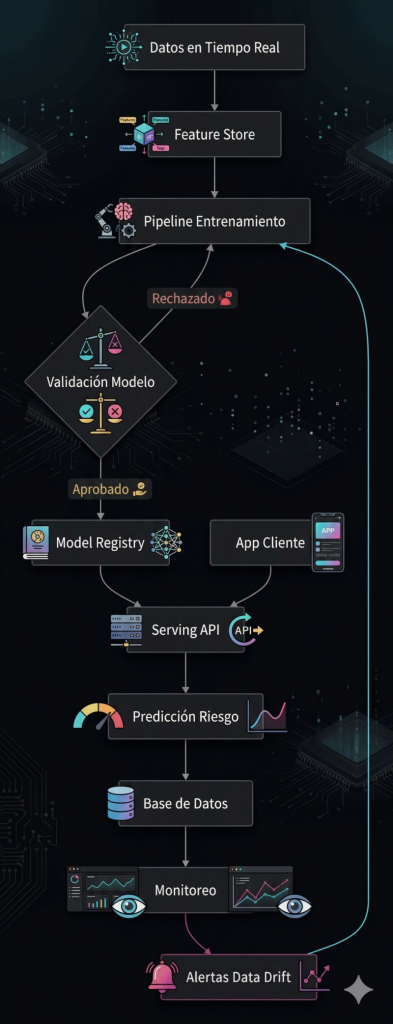

Arquitectura MLOps Completa:

Beneficios obtenidos con MLOps:

- Primas más precisas: Reducción del 15% en pérdidas por sub-precio

- Detección de fraudes: Identifican el 40% más de fraudes

- Automatización: Evaluación de siniestros en 2 horas vs. 48 horas

- Actualizaciones: Reentrenamiento automático cada semana

Nuevos problemas:

- Regulación: Necesitan explicabilidad para supervisores

- Siniestros complejos: Algunos casos requieren interpretación de lenguaje natural

- Atención al cliente: Los agentes no pueden explicar decisiones del modelo

- Documentación: Procesar informes de peritos lleva mucho tiempo

Fase 3: LLMOps (Asistente Inteligente de Siniestros)

Innovación: Implementan un agente LLM que:

- Lee y resume informes de peritos

- Explica decisiones a clientes

- Asiste a agentes en tiempo real

- Genera documentación regulatoria

Código python

# Sistema LLMOps con agente especializado

class InsuranceLLMAgent:

def __init__(self):

self.llm = LLMClient(model="claude-3-opus")

self.tools = {

'policy_lookup': PolicyDatabaseTool(),

'claim_analyzer': ClaimAnalysisTool(),

'fraud_detector': FraudDetectionTool(),

'document_processor': DocumentProcessingTool(),

'regulation_checker': ComplianceTool()

}

self.prompt_manager = PromptManager()

self.evaluator = AgentEvaluator()

def optimize_insurance_prompts(self):

"""Optimización específica para seguros"""

optimized_prompt = self.prompt_manager.optimize(

base_prompt="""Eres un especialista en seguros con 20 años de experiencia.

Objetivo: {objective}

Regulaciones aplicables: {regulations}

Contexto del caso: {context}""",

optimization_algorithm="HRPO", # Hierarchical Reflective Prompt Optimizer

evaluation_metrics=[

'accuracy_explanation', # ¿La explicación es técnicamente correcta?

'regulatory_compliance', # ¿Cumple normativas?

'customer_clarity', # ¿El cliente lo entendería?

'processing_speed' # ¿Resuelve en tiempo adecuado?

],

training_data=self.load_insurance_cases(n=1000)

)

return optimized_prompt

def process_claim(self, claim_id, customer_query=None):

"""Procesa un siniestro completo"""

# 1. Recopilar contexto

context = self.build_claim_context(claim_id)

# 2. Ejecutar agente con herramientas

result = self.llm.run_agent(

system_prompt=self.optimized_prompt,

user_query=customer_query or "Procesar este siniestro",

available_tools=self.tools,

tool_selection_strategy="dynamic", # El LLM decide qué herramientas usar

max_processing_time="5m"

)

# 3. Logging detallado para auditoría

self.log_audit_trail({

'claim_id': claim_id,

'llm_reasoning': result.chain_of_thought,

'tools_used': result.tool_calls,

'confidence_scores': result.confidence,

'regulatory_checks': result.compliance_checks

})

# 4. Evaluación continua del agente

self.evaluator.log_interaction(

claim_id=claim_id,

agent_response=result,

human_feedback=None, # Se recibe después

auto_metrics=self.calculate_auto_metrics(result)

)

return result

Flujo LLMOps para Procesamiento de Siniestros:

Siniestro Reportado

↓

[Agente LLM Analiza]

├──► Lee informe perito (DocumentProcessingTool)

├──► Consulta póliza (PolicyDatabaseTool)

├──► Verifica fraudes (FraudDetectionTool)

├──► Revisa regulación (ComplianceTool)

↓

[Genera Resolución]

├──► Decisión: Aprobar/Rechazar/Investigar

├──► Cálculo indemnización

├──► Explicación para cliente

├──► Documentación regulatoria

↓

[Optimización Continua]

├──► Feedback agente humano → Ajuste prompts

├──► Casos difíciles → Nuevo training data

├──► Actualización regulaciones → Prompt update

Comparación Concreta en la Aseguradora

| Caso de Uso | DevOps | MLOps | LLMOps |

|---|---|---|---|

| Cliente reporta accidente | Formulario web → Procesamiento manual en 3 días | Sistema clasifica urgencia → Deriva automáticamente en 2 horas | Agente conversacional: «Entiendo su accidente. ¿Necesita grúa? Ya localicé talleres cercanos aprobados» |

| Evaluación de daños | Agente visita → Fotos → Presupuesto manual | Modelo de CV analiza fotos → Estima costo con 85% precisión | LLM lee informe perito + analiza fotos → Explica: «El daño en panel B requiere reemplazo porque…» |

| Detección de fraude | Reglas simples: múltiples siniestros en corto tiempo | Modelo de anomalías detecta patrones sutiles en 50+ variables | LLM analiza narrativa del siniestro: «La descripción no coincide con las fotos porque…» |

| Cálculo de prima renovación | Aumento fijo del 5% anual | Modelo predictivo ajusta según riesgo individual actualizado | Agente explica: «Su prima sube 3% porque aumentaron accidentes en su zona, pero le damos 2% descuento por buen historial» |

| Cumplimiento regulatorio | Checklist manual anual | Monitoreo automático de cambios en dataset | LLM genera reporte regulatorio + explica cada decisión en lenguaje natural |

| Tiempo procesamiento siniestro | 5-10 días hábiles | 24-48 horas | 2-4 horas para casos estándar |

| Costo operacional | $50 por siniestro (mano de obra) | $15 por siniestro (infraestructura ML) | $3 por siniestro (costo tokens + optimización) |

Resultados Cuantificados de la Transformación

| Métrica | DevOps | MLOps | LLMOps | Mejora |

|---|---|---|---|---|

| Tiempo procesamiento siniestro | 7.2 días | 1.5 días | 0.3 días | 24x más rápido |

| Precisión cálculo indemnización | 70% | 89% | 94% | +24 puntos |

| Fraudes detectados | 15% | 45% | 68% | +53 puntos |

| Satisfacción cliente | 3.2/5 | 4.1/5 | 4.7/5 | +47% |

| Costo operacional/siniestro | $50 | $15 | $8 | -84% |

| Cumplimiento regulatorio | 82% | 91% | 98% | +16 puntos |

| Capacidad casos/día | 100 | 450 | 1,200 | 12x más capacidad |

Hoja de Ruta de Implementación para Aseguradoras

Fase 1: DevOps (Mes 1-3)

yaml

objetivo: "Automatizar procesos manuales"

acciones:

- Dockerizar aplicaciones existentes

- Implementar CI/CD para sistemas de facturación

- Crear APIs para agentes externos

- Monitoreo básico (uptime, errores)

herramientas: Jenkins, Kubernetes, PrometheusFase 2: MLOps (Mes 4-9)

yaml

objetivo: "Predecir riesgos y optimizar precios"

acciones:

- Feature store para datos de clientes

- Pipeline entrenamiento modelos de riesgo

- Sistema detección fraudes en tiempo real

- Monitoreo data drift en variables clave

herramientas: MLflow, Feast, Evidently AIFase 3: LLMOps (Mes 10-15)

yaml

objetivo: "Experiencia conversacional y automatización compleja"

acciones:

- Agente LLM para procesamiento siniestros

- Optimización prompts específicos seguros

- Sistema explicabilidad decisiones para reguladores

- Integración herramientas existentes con LLM

herramientas: Opik, LangChain, LlamaIndexLecciones Clave para el Sector Seguros

- Start simple: No intentes LLMOps sin bases DevOps sólidas

- Datos primero: La calidad de datos es crítica para MLOps y LLMOps

- Regulación: En seguros, la explicabilidad no es opcional

- Transición gradual: Muchos sistemas pueden coexistir durante la migración

- ROI claro: En seguros, cada mejora en detección de fraudes tiene impacto directo en resultados

Pregunta clave para tu aseguradora: ¿En qué etapa está actualmente y cuál sería el siguiente paso más valioso?

Deja una respuesta